NVIDIAが合成データで構築した多言語OCRモデルを公開

1,200万枚の合成画像で訓練したNemotron OCR v2、非英語言語の認識誤り率を最大94%削減

- •NVIDIAが6言語にわたる1,200万枚の合成画像で訓練した多言語OCRモデルNemotron OCR v2を公開した。

- •非英語言語のNED誤り率が0.56〜0.92から0.035〜0.069へと最大94%改善された。

- •単一A100 GPUで毎秒34.7ページを処理し、データセットとモデルはともにオープンソースで公開されている。

NVIDIAが多言語OCRモデル「Nemotron OCR v2」を公開

NVIDIAが合成データ(Synthetic Data)を活用した多言語光学文字認識(OCR)モデル「Nemotron OCR v2」を公開した。6言語にわたる1,200万枚の合成学習画像で訓練されたこのモデルは、単一のA100 GPUで毎秒34.7ページを処理する速度を実現した。非英語言語における正規化編集距離(NED)スコアは従来の0.56〜0.92から0.035〜0.069へと大幅に改善された。データセットはnvidia/OCR-Synthetic-Multilingual-v1、モデルはnvidia/nemotron-ocr-v2としてHugging Faceで公開されている。

なぜ重要か:合成データがOCRのデータボトルネックを突破

OCRモデル開発における中心的な障壁は常に「データ」だった。高品質な訓練には、単語・行・段落レベルの精密なバウンディングボックスと読み順情報を含む画像テキストペアの手動アノテーションが必要だ。数百万枚規模でこれを手作業で行うことは、経済的にも実務的にも現実的ではない。

ICDARやTotal-Textなどの既存ベンチマークデータセットはラベル品質は高いが規模が数万枚に留まり、英語と中国語に偏っている。WebスクレイピングしたPDFは量は多いが、テキストレイヤーが不完全だったり低品質なOCR結果物が混在していたりと信頼性に欠ける。

合成データはこの二つの限界を同時に解決する。テキストを画像にプログラム的にレンダリングすることで、バウンディングボックス・転写・読み順の関係がすべて「正確に既知」の状態で生成できる。課題は現実感(Realism)だ。フォント、色、背景、レイアウト、拡張(Augmentation)を十分に多様化することで、実際の文書への汎化能力が確保される。

何が変わったか:v1 vs. v2

| 項目 | Nemotron OCR v1 | Nemotron OCR v2 | 変化 |

|---|---|---|---|

| 対応言語 | 英語中心 | 6言語(英・日・韓・露・中等) | 多言語へ拡張 |

| 文字セット | 855文字 | 14,244文字 | CJK・キリル文字を含む |

| 学習データ | 限定的 | 1,200万枚の合成画像 | 大規模合成データ |

| 非英語NEDスコア | 0.56〜0.92 | 0.035〜0.069 | 最大94%改善 |

| 処理速度 | 非公開 | 34.7ページ/秒(A100×1) | 共有バックボーン構造導入 |

| アーキテクチャ | 独立モジュール | 検出・認識・関係モデルで共有バックボーン | 冗長計算を排除 |

v1からv2への移行は、アーキテクチャ改善ではなく「データ問題の解決」が本質だった。NVIDIAの研究チームはまず文字セットを14,244文字に拡張する実験を行ったが、対応する学習データなしでは改善は限定的だった。モデルは理論上正しい文字を出力できても、それらの視覚的特性を学習したことがなかった。

歴史的な流れ:OCRと合成データの交差点

Document AIにおける合成データの活用は2010年代半ばから本格化した。DeepMindのSynthText(2016)が文字検出タスクでシーンへのテキスト合成を先駆け、後にドキュメント理解モデルの訓練へと拡張された。NAVERのSynthDoG(2022)は多言語文書画像合成パイプラインを公開して注目を集めたが、当時は合成データのみで実際の文書レベルの精度を達成することは依然として困難だった。

NVIDIAの今回の発表は、レンダリングエンジンの多様性と無作為化のレベルが十分に高い場合、合成データのみでも実用的な多言語OCRが実現可能であることを示した事例だ。大規模言語モデル(LLM)の急速な普及がこの流れを加速させ、文書からテキストを抽出してLLMに入力するパイプラインが一般化するにつれ、多言語OCRの重要性はさらに高まっている。

[専門家分析] 今後の展望と示唆

今回の公開で注目すべきは、モデルだけでなくパイプライン自体が公開されたことだ。研究チームは合成データパイプラインがフォントとソーステキストさえあれば任意の言語に拡張可能な設計だと述べており、リソースが少ない言語圏の研究者にとって参入障壁の実質的な低減となる可能性が高い。

速度面でも示唆は大きい。A100単一GPUで毎秒34.7ページは、企業環境での大量文書処理(バッチ処理)に実用的なレベルだ。検出・認識・関係モデルがバックボーンを共有する構造は冗長計算を排除し、この速度を可能にしている。

ただし合成データベースモデルの限界も存在する。手書き文字、著しく劣化した歴史的文書、専門ドメイン用語など、合成データで十分にカバーしにくい分布での性能は追加検証が必要だ。Nemotron OCR v2は企業文書処理、RAG(検索拡張生成)パイプラインの前処理、多言語デジタルアーカイブ構築などに幅広く活用される可能性が高い。オープンソース公開がコミュニティ主導の追加言語拡張につながるかが今後の注目点となる。

댓글 (17)

이런 시각도 있었군요. Nemotron-OCR 주제로 시리즈 기사가 나오면 좋겠습니다.

다른 기사도 기대하겠습니다.

기사 잘 읽었습니다.

유익한 기사네요. OCR에 대한 다른 매체 보도와 비교해봐도 잘 정리되어 있습니다.

Nemotron-OCR 주제로 시리즈 기사가 나오면 좋겠습니다. 잘 정리된 기사네요.

매일 여기서 뉴스 보고 있어요.

북마크해두겠습니다. Nemotron-OCR 관련 데이터가 인상적이었습니다. 생각이 바뀌었습니다.

OCR에 대한 다른 매체 보도와 비교해봐도 잘 정리되어 있습니다. 나중에 다시 읽어볼 만합니다.

Nemotron-OCR 기사에서 언급된 사례가 흥미로웠습니다.

흥미로운 주제입니다. OCR이 앞으로 어떻게 전개될지 주목해야겠습니다. 나중에 다시 읽어볼 만합니다.

Nemotron-OCR 주제로 시리즈 기사가 나오면 좋겠습니다. 좋은 기사 감사합니다.

몰랐던 사실을 알게 됐습니다. OCR 기사에서 언급된 사례가 흥미로웠습니다. 후속 기사 부탁드립니다.

잘 읽었습니다. Nemotron-OCR에 대해 처음 접하는 정보가 있었습니다.

잘 읽었습니다. OCR에 대해 처음 접하는 정보가 있었습니다. 다른 시각의 분석도 읽어보고 싶습니다.

Nemotron-OCR이 앞으로 어떻게 전개될지 주목해야겠습니다.

잘 읽었습니다. OCR의 향후 전망이 궁금합니다.

흥미로운 주제입니다. Nemotron-OCR 관련 용어 설명이 친절해서 좋았습니다.

このシリーズの他の記事

AI・テックの記事をもっと見る

最新ニュース

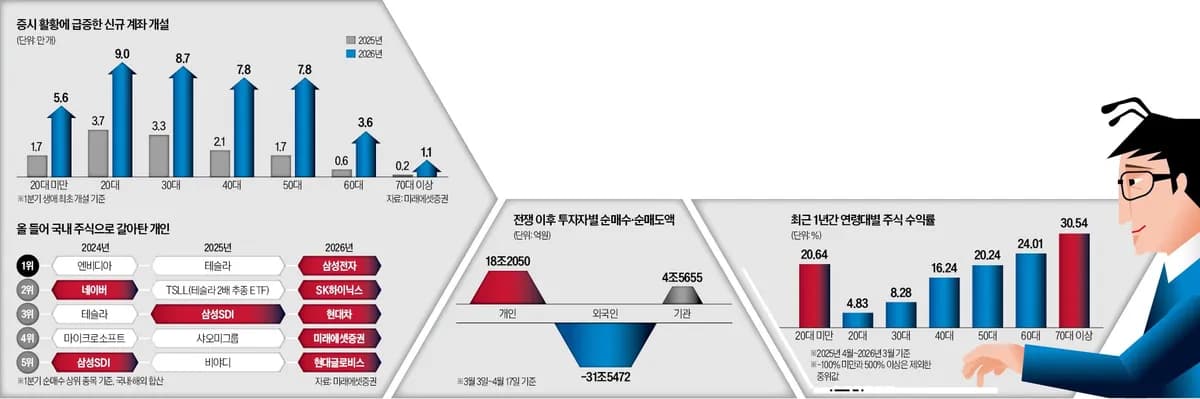

恐怖で買い、強欲で売る——個人投資家がKOSPI5000を死守した立役者に

東学アリが外国人売りを吸収し、KOSPI5000ポイント死守に核心的な役割を果たす

중국 스마트폰 시장 침체 속 애플 아이폰 출하 20% 급증

애플 아이폰의 중국 1분기 출하량이 전년 대비 20% 급증해 주요 업체 중 최고 성장률을 기록했다.

이란 전쟁發 에너지 위기, EU 스태그플레이션 경계선에 서다

IMF가 이란 전쟁發 에너지 위기로 EU 경기침체 가능성을 경고했다.

米ICE長官代行トッド・ライオンズ氏、5月末に辞任へ 国土安全保障省が発表

DHSがICE長官代行トッド・ライオンズ氏の5月末辞任を正式発表

トランプ氏「海上封鎖は継続」、イランはホルムズ海峡の完全開放を宣言

トランプ氏、対イラン海上封鎖の継続を再確認 イスラエルのレバノン追加攻撃はないと明言

호르무즈 봉쇄가 바꾼 에너지 지도, 재생에너지 전환 가속

호르무즈 해협 봉쇄로 하루 1,300만 배럴 원유 공급이 차질을 빚으며 유가가 급등했다.

호르무즈 재개방 선언에도 파나마 운하 적체 해소 '요원'

이란이 호르무즈 해협 완전 개방을 선언했지만 미 해군 봉쇄는 유지됐다.

호르무즈 해협 재개방에 금값 급등·유가 폭락

이란의 호르무즈 해협 재개방 선언에 금값이 3월 이후 최고치로 상승했다.